ESTUDIO DE LA UNIVERSIDAD DE OXFORD

Las redes sociales como instrumento de propaganda

Internet está inundada de cuentas falsas que buscan orientar a la opinión pública. En Rusia, el 45% de la actividad de Twitter está controlada por robots. Durante la campaña electoral en EEUU, más de un millón de tuits estaban programados

Gabriel Méndez-Nicolas 2/08/2017

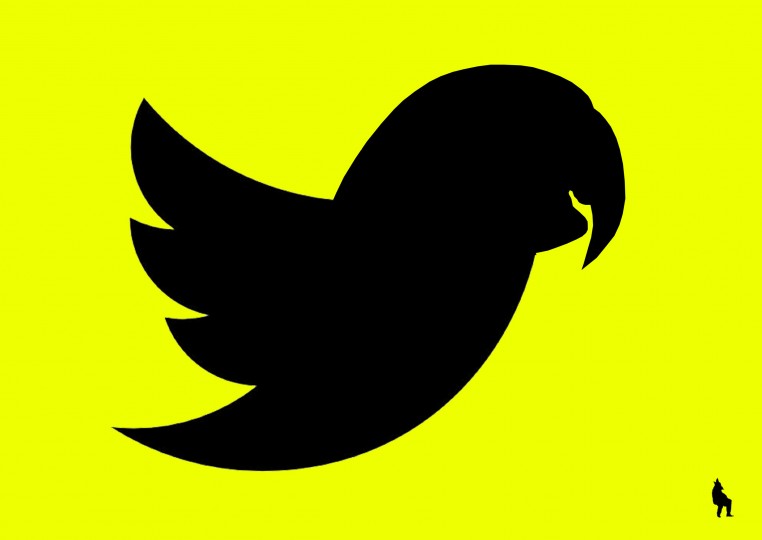

Twitter.

LA BOCA DEL LOGOEn CTXT podemos mantener nuestra radical independencia gracias a que las suscripciones suponen el 70% de los ingresos. No aceptamos “noticias” patrocinadas y apenas tenemos publicidad. Si puedes apoyarnos desde 3 euros mensuales, suscribete aquí

Necesitamos tu ayuda para realizar las obras en la Redacción que nos permitan seguir creciendo. Puedes hacer una donación libre aquí

-----------------------------------------------------------------------------------------------------

El 17 de julio de 2014, un Boeing 777 de Malaysian Airlines que volaba desde Ámsterdam a Kuala Lumpur se estrelló en la región ucraniana de Donbas, un área fuera del dominio del Gobierno ucraniano y controlada por los separatistas prorusos. Los 298 pasajeros fallecieron. En 2016, una investigación realizada por expertos internacionales concluyó que el avión fue alcanzado por un misil ruso antes de estrellarse. Hasta entonces, existían numerosos bulos en internet sobre lo que había acontecido. Uno de ellos era la presencia en la zona de un caza ucraniano que habría destruido la aeronave. Esta versión fue iniciada por un usuario español, un supuesto controlador aéreo llamado Carlos –@spainbuca–, que decía trabajar en el aeropuerto Boryspil. Aseguraba que había visto un avión de guerra en la zona de la catástrofe. Esta historia fue rápidamente difundida por medios de comunicación rusos como RT –muy próximo al gobierno– y por el Ministerio de Defensa ruso. Su titular, Serguéi Shoigú, usó en rueda de prensa una imagen de satélite falsa en la que se veía un avión de combate Su-25 en la zona donde transitaba el avión de Malaysian Airlines.

La web StopFake destapó el bulo: ningún ciudadano no-ucraniano puede ser controlador aéreo en Ucrania, así que la cuenta de Twitter del supuesto controlador aéreo español era falsa. El 8 de mayo de 2014, un hombre con el rostro tapado, que dijo llamarse Carlos, denunció amenazas hacia su persona por parte del Gobierno ucraniano en entrevista a la versión española de RT. No se ha encontrado ninguna prueba de que Carlos exista realmente. La cuenta empezó su actividad 2 meses antes del suceso, cambiando varias veces de nombre –como por ejemplo Lyudmila Lopatyshkina– y compartiendo constantemente mensajes a favor del Gobierno ruso.

Los gobiernos están utilizando las redes sociales con fines propagandísticos para influir en la opinión pública. Esta es una de las conclusiones a las que llega el estudio de la Universidad de Oxford Computational Propaganda Research Project, un proyecto dedicado al “uso de las redes sociales para la manipulación”. Doce investigadores de nueve países diferentes han analizado la importancia que tienen las cuentas programadas en redes a la hora de manipular a la opinión pública. Y no solo en Estados totalitarios, también en democracias asentadas.

La parte de la investigación dedicada a Ucrania, liderada por Mariia Zhdanova y Dariya Orlova, concluye que la cuenta del supuesto controlador no era la única activa en el caso del Boeing 777 de Malaysian Airlines. Tras la publicación de las conclusiones del informe que vinculaba a Rusia con el siniestro, se apreciaron otras actividades por parte de cuentas programadas. Cuando alguien publicaba un tuit con el hashtag #MH17 en ruso, un bot interpelaba al usuario en cuestión, enviando un artículo falso que desacreditaba y desmontaba la investigación que había determinado la culpabilidad de Rusia.

Bot es un acortamiento válido del término robot, empleado en el ámbito de la informática para referirse al “programa que recorre la red llevando a cabo tareas concretas, sobre todo creando índices de los contenidos de los sitios” (Fundéu). En este caso son programas inteligentes, automáticos o coordinados por personas físicas, que detrás de un seudónimo se hacen pasar por cuentas reales en las redes sociales. La dificultad para diferenciar usuarios reales de bots es lo que hace peligrosas estas cuentas programadas, que pueden crear una ilusión de popularidad hacia un candidato o político, difundir noticias falsas, calmar protestas o, simplemente, inundar las redes sociales de propaganda política. Esta propaganda digital es “de las herramientas más poderosas contra la democracia”, afirma Sam Woolley, director de la investigación, y el investigador principal Phil Howard en el sumario del informe.

Según las conclusiones de los expertos de la Universidad de Oxford, alrededor de un millón de tuits fueron publicados por programas automáticos: una quinta parte de los favorables a Clinton y un tercio de los elogiosos con Trump

Fake news y elecciones en Estados Unidos

Las elecciones en Estados Unidos han sido las más seguidas en todo el mundo y han puesto sobre la mesa el concepto de fake news. La investigación sobre este país consta de dos partes: una parte dedicada al estudio de las redes y de los datos; y otra, que analiza la presencia de bots durante el periodo electoral de 2016. Según las conclusiones de los expertos de la Universidad de Oxford, alrededor de un millón de tuits fueron publicados por programas automáticos: una quinta parte de los favorables a Clinton y un tercio de los elogiosos con Trump.

El actual presidente de Estados Unidos, que tras los debates se jactaba de haberlos ganado por su popularidad en las redes sociales, es el candidato que más ha utilizado estos procedimientos de manipulación.

Un ejemplo de las tácticas del equipo de Trump fue el Pizzagate. En noviembre de 2016, en plena batalla por la presidencia de EEUU, salió a la luz un escándalo de pedofilia que implicaba al director de campaña de Hillary Clinton, John Podesta. Según unos supuestos mails que destapó WikiLeaks, Podesta estaba vinculado a una pizzería que servía de acceso a una red de pedofilia. La policía y distintos medios de comunicación desmintieron esta historia, pero las redes sociales siguieron propagándola. El informe de Oxford descubre que una parte importante de la conversación en Twitter sobre el Pizzagate fue realizada por cuentas en países como Chipre, Vietnam o República Checa. Los bots favorables a Donald Trump amplificaron notablemente este bulo.

Estas cuentas no solo se activaron para las elecciones presidenciales. El informe destaca también su actividad en las primarias republicanas, atacando, por ejemplo, a otro candidato en esas primarias, Ted Cruz.

Ahora, el debate en Estados Unidos gira en torno a si Rusia está detrás de todos estas cuentas afines a Trump. El análisis de los datos que aparecen en el informe vincula a muchos de estos bots, que tuvieron un papel importante en la difusión de las fake news de Donald Trump y su posterior victoria en las elecciones, con hackers rusos.

Uso de bots en la manipulación de la opinión pública

Brasil es otro de los casos paradigmáticos en el uso de cuentas falsas con fines propagandísticos. En 2016, Symantec, una multinacional especializada en ciberseguridad, destacó que el país estaba en la octava posición mundial en número de bots presentes en sus redes.

El informe de la Universidad de Oxford concluye que esas cuentas falsas tuvieron un papel importante en las elecciones brasileñas de 2014 que auparon a Dilma Rousseff a la presidencia, y que “esos mismos métodos han sido utilizados para guiar a muchas personas hacia grupos opositores a ella”. Una muestra de ello fue la actividad en Twitter durante el debate presidencial de 2014 entre Rousseff y el candidato del PSDB Aécio Neves. Según un estudio realizado por Folha Sao Paulo –un grupo de apoyo a Rousseff– 15 minutos después del debate, los tuits con un hashtag favorable a Neves se triplicaron.

Estos mismos bots que se usaron para la campaña electoral de 2014 están también presentes en el proceso de impeachment en 2016. No es sorprendente que estas cuentas falsas inunden las redes sociales si tenemos en cuenta que, por ejemplo, varias compañías, como Brasil Liker, venden likes a las cuentas de Facebook registradas en Brasil. Con unas tarifas bastante asequibles, el acceso a la utilización de bots en las redes sociales parece bastante fácil para cualquiera.

Estos programas pueden tener varias misiones dentro de la estrategia de manipulación. Una de ellas es crear un consenso falso en torno a un tema específico

Los expertos de Oxford aportan datos muy significativos de la importancia que pueden tener estas cuentas programadas a la hora de manipular la opinión pública. Según el informe, alrededor del 45% de la actividad de Twitter en Rusia está controlada por bots. Estos programas pueden tener varias misiones dentro de la estrategia de manipulación. Una de ellas es crear un consenso falso en torno a un tema específico: construyen la ilusión de que muchos usuarios están de acuerdo, cuando en realidad detrás de esas cuentas ni siquiera existen personas físicas.

En Polonia, por ejemplo, entre marzo y abril de 2017, 10.050 cuentas de Twitter –sospechosas de haber sido programadas– publicaron 50.058 tuits. Un pequeño grupo de usuarios (de la derecha y la extrema derecha polaca) generó alrededor del 20% de la actividad en Twitter. Que un porcentaje tan grande de la actividad de una red social sea producido por tan pocos usuarios prueba la capacidad de estas cuentas automatizadas para crear un debate sobre temas no necesariamente generalizados.

Otro de los usos de estos bots es la capacidad de arremeter contra rivales políticos mediante un ataque coordinado por las redes sociales. Esto fue lo que, según el informe, se hizo en Taiwán en 2017 para desestabilizar a la presidenta de ese país. Tsai Ing-wen fue atacada de manera “pueril y misógina” a través de perfiles creados uno o dos mese antes, que no tenían foto, pocos o ningún seguidor, tuiteaban en chino simplificado y muchas de las cuales han desaparecido desde que salió el estudio de la Universidad de Oxford.

Pero, ¿tienen las redes sociales alguna responsabilidad de lo que se publica en ellas? El informe señala que ni Facebook ni Twitter hacen todo lo posible para proteger a sus usuarios de este tipo de cuentas robotizadas.

Twitter posee un sistema anti-bots, pero está centrado en la lucha contra la publicidad abusiva en la red: no existe ningún sistema para terminar con la manipulación política o ideológica. Los usuarios tienen que protegerse solos, denunciando las cuentas que sospechen programadas. Facebook tampoco parece más interesado en el tema, y ha contratado la lucha contra la propaganda digital y la difusión de noticias falsas a dos empresas externas: Associated Press y Snopes actúan como una especie de subcontrata de Facebook en estos temas.

Alemania contra los bots

Alemania –que, según la investigación, a pesar de haber tenido muy poca presencia de cuentas automatizadas en sus redes, sí tiene una importante difusión de bulos y noticias falsas en las mismas– es de los pocos países que ha iniciado una serie de propuestas legislativas para que las redes sociales se hagan responsables del contenido que circula en ellas. El grupo parlamentario alemán Alianza 90/Los Verdes ha exigido una ley para identificar a los bots en las redes sociales con el objetivo de reconocer cuándo una publicación es obra de un robot.

En Taiwan el gobierno ha puesto en marcha bots que van a cumplir un papel de “fact checking” para proteger a sus usuarios de la difusión de noticias falsas.

El informe Computational Propaganda Research Project llega a la conclusión de que internet está inundado por bots, activos o todavía “durmientes”. Revela también que los países con menor acceso a Twitter u otras redes sociales se ven menos tocados por la manipulación ejercida por cuentas programadas. Y admite que la lucha contra la propaganda digital a través de las redes sociales es muy difícil de llevar a cabo, porque cada país tiene una regulación distinta sobre el tema. Por el momento existe un puñado de iniciativas legislativas y algunas empresas privadas de fact checking como Chequeado o FactCheck.org -las dos sin ánimo de lucro- para combatir la desinformación y la difusión de fake news. Contra esta propaganda del siglo XXI, virtual y oculta, cualquier lucha parece poca.

Necesitamos tu ayuda para realizar las obras en la Redacción que nos permitan seguir creciendo. Puedes hacer una donación libre aquí

Autor >

Suscríbete a CTXT

Orgullosas

de llegar tarde

a las últimas noticias

Gracias a tu suscripción podemos ejercer un periodismo público y en libertad.

¿Quieres suscribirte a CTXT por solo 6 euros al mes? Pulsa aquí